完善资料让更多小伙伴认识你,还能领取20积分哦, 立即完善>

3天内不再提示

》大赛介绍

本次大赛由中国电子学会联合发起,电子发烧友携手进迭时空设立“CIE-进迭时空RISC-V应用创新赛道”,含4大参赛主题,请选择1个参赛:

赛题1:基于K1的人工智能终端及应用开发

赛题2:基于K1 AI CPU的大模型部署落地

赛题3:基于本地大模型的AI智能助手开发

赛题4:融合AI的OpenHarmony应用软件开发

!重要提示:

1)申请报名时,请务必在项目计划中首行填写你的参赛赛题;

2)支持团体参赛,在项目计划中备注团队各成员姓名;

3)如为在校学生,公司栏可填写学校名称。

》技术平台

本赛道以进迭时空K1 CPU的开发板为硬件底座,搭配开源开发的系统OS基座和的丰富软件组件,进迭时空学习套件提供丰富的样例代码和使用说明,加速用户学习和开发流程。

1. 芯片K1及开发板介绍

(1)芯片K1介绍

K1是Spacemit Stone系列的首颗芯片,基于RISC-V开源指令集,专为高性能、低功耗场景设计,适用于机器人、边缘计算等领域。

1)主要特性

• 出色的CPU性能:8核RISC-V AI CPU,提供50K DMIPS算力,单核性能Specint2006 > 4.0/GHz。

• 强大的AI算力:2 TOPS AI算力,支持本地大模型运行(>10 Tokens/S @1B模型)。

• 先进的RISC-V架构:支持RVA22 Profile和256bit RVV 1.0标准,向量性能是ARM NEON的150%。

• 高能效设计:同负载场景功耗仅为同档芯片的80%。

• 丰富的外设接口:集成PCIe、USB、GMAC、SPI等,满足多样化连接需求。

• 工业级可靠性:支持-40°C~85°C工作温度,适用于苛刻环境。

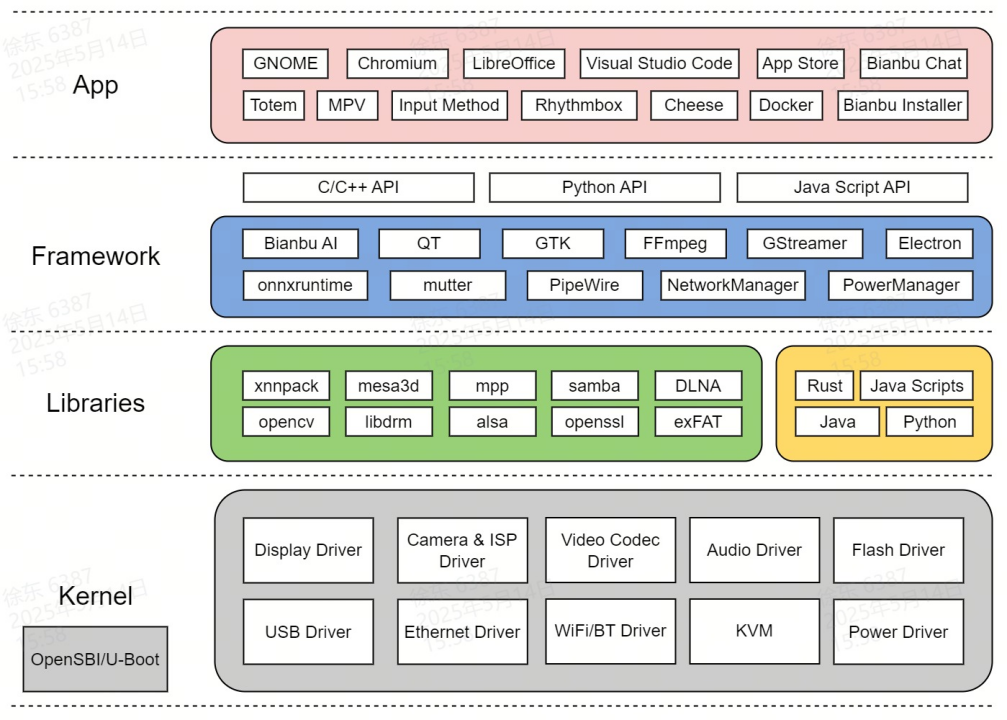

2)软件生态

• 完善的SDK支持:提供Bianbu Linux BSP,包含OpenSBI、U-Boot、Linux内核、根文件系统及示例代码。

• 主流操作系统支持:适配Bianbu OS(基于Ubuntu优化)、OpenHarmony、OpenWR等。

• 机器人开发支持:支持ROS2,提供机器人算法开发和调试工具。

• AI组件:集成硬件加速的ONNX Runtime框架,支持深度学习推理, 支持ollama和llama.cpp。

• 云上开发平台Bianbu Cloud:支持一键注册,远程连接硬件平台,实现云端开发调试。

(2)硬件平台介绍

MUSE Pi Pro是基于进迭时空8核 RISC-V CPU K1芯片的单板计算机、具有大容量DRAM和存储空间、丰富通用接口部件和扩展接口,为机器人、边缘计算、AIOT等场景设计。具有2TOPS算力,配套本地大模型和视觉算法,能够高效搭建多样化的智能产品,让智能应用更简单。

可扩展外设部件或自制件

40pin接口定义如下,通用输入输出电平控制,UART、SPI、I2C等串行接口资源,支持连接各类DIY配件。

(3)基于K1的机械臂介绍

基于K1芯片的强大算力和丰富接口,机器臂能够实现更高效的机器人控制和智能化应用,为参赛选手提供创新的开发平台。

1)myCobot 280 Risc-V机械臂

• 自由度:6轴。

• 有效负载:250g。

• 工作半径:280mm。

• 重复定位精度:±0.5mm。

• 重量:860g。

• 特点:轻量化设计,支持ROS开发,适合教育、科研场景。

2)功能与优势

基于K1芯片的支持,搭配机械臂和移动机器人能够实现以下共同功能:

1. 视觉抓取与精准操作

• 结合K1芯片的AI算力,支持物体识别与定位,实现高精度抓取。

• 通过手眼标定算法(如myCobot Camera Flange 2.0),实现精准吸取和放置操作。

2. 路径规划与避障

• 利用K1芯片的并行计算能力,支持复杂路径规划和动态避障功能。

• myAGV 2023 配备360°激光雷达,可实现高精度环境感知与导航。

3. 多机协同与任务分配

• 通过K1芯片的多核性能,支持多机器人协同工作,完成复杂场景任务。

• 例如,myAGV 2023 可搭载 myCobot 280Pi 机械臂,实现移动抓取与分拣任务。

4. 实时控制与高效响应

• K1芯片的低延迟特性确保机器人系统的实时响应能力。

• 适用于需要高精度和高实时性的场景,如物流分拣和自动化装配。

5. 开放生态与灵活开发

• 支持ROS开发,提供丰富的API和开发工具,便于二次开发和功能扩展。

• 适用于教育、科研和商业预研等多种场景。

6. 可视化编程工具支持

• 适配支持K1芯片的可视化编程工具,提供图形化编程界面,用户可通过拖拽和拼接功能模块快速完成机械臂和移动机器人的控制程序开发。

• 适用于机器人编程教学,帮助学生理解机器人控制逻辑和算法原理。

2. 软件平台介绍

Bianbu

Bianbu是一个融合桌面操作系统,针对RISC-V架构的处理器做了深度优化,基于Ubuntu社区源码构建,旨在给用户提供更流畅、更兼容和更简洁的体验。基于Bianbu Star系统,我们定制开发桌面环境,不断优化用户交互流畅性;持续融合AI,提供系统原生AI能力;兼容支持更多RISC-V构架下的应用,丰富软件生态。

Bianbu cloud

Bianbu cloud是进迭时空为了服务全球RISC-V开发者而构建的RISC-V云实例, 为全球开发者提供RISC-V计算实例,支持远程桌面、远程编译、一键刷机、一键应用安装、远程SSH调试、串口调试等功能,让开发者可以随时随地的使用RISC-V算力并做创意开发。

• RISC-V 应用调试

用户可以远程ssh、远程桌面,远程编译,上传文件等功能适配应用到RISC-V 平台

• 远程驱动调试

用户可以使用远程串口,一键固件刷机调试Uboot和Linux驱动

• RISC-V 场景体验

体验Risc-V架构下操作系统及相关应用使用体验

• RISC-V 开发板评估

用户评估开发板是否满足业务需求

》活动时间

1.申请报名:2025年9月11日 - 10月8日

2.名单审核:申请报名后一周内审核1次

3.提交作品:截止2025年11月8日

ps:报名审核通过后,即可安排发放相应开发板套件(赛题1)、云平台账号(赛题2-4)

》作品报告

1.最终参赛作品需同时在电子发烧友论坛-进迭时空小组和大赛组委官方(大赛群会另行通知)发布提交;

2.电子发烧友论坛作品报告提交格式:【CIE全国RISC-V创新应用大赛】+自拟标题;

3.活动期间鼓励不定期在电子发烧友论坛-进迭时空小组,上传开发进度、日记、经验分享等内容,大赛结束后必须上传最终参赛作品。

4.如未按要求上传相应内容,将取消活动评选资格。

》技术支持

1. 赛题开发平台

2. 硬件申领

1)本赛题1 所使用到的MUSE Pi Pro开发板,在赛事结束后需回收;

2)本赛题2-4,所使用到的云上开发平台,依据报名分配账号。

3. 可选配件/组件

购买渠道:进迭时空官方淘宝店

备注:如果项目需要其他传感器或者执行单元,可以根据需求选择和适配。

》大赛奖项

1. 决赛阶段

得分前30%的参赛项目团队可获得由中国电子学会与进迭时空共同盖章颁发的决赛奖励证书。

2.总决赛阶段

优胜奖:全国总决赛得分排在前20%;

专项奖:技术创新、商业价值、发展潜力等,根据全国总决赛参赛项目现场表现,由大赛评审委员会进行推荐(不含已获优胜奖的项目);

所有获得全国总决赛优胜奖和专项奖的参赛项目,其所属团队均可获得由中国电子学会盖章颁发的全国总决赛奖励证书。

3.奖金池

奖金池共人民币10万元(含税),平均分配给全国总决赛优胜奖的参赛项目。

》参赛说明(请仔细阅读)

赛题1 基于K1的的人工智能终端及应用开发

本赛题要求基于进迭时空RISC-V AI CPU平台K1,构建支持机器视觉(CV)、语音识别(ASR)、大语言模型(LLM)协同的轻量化系统,实现环境感知、语义理解与实体交互闭环,完成智能终端软硬件一体化开发。

1.项目要求

1)使用进迭时空KI 芯片平台的开发板或机械臂,并按需选择搭配合适配件(非必须),基于进迭时空Bianbu OS系统,结合K1芯片平台的AI算力,实现多模态协同(至少选择CV,ASR,LLM中的两种);

2)本地完成AI部署和推理,通过外设模块(摄像头、麦克风、传感器等)构建完整数据链路;

3)展现AI模型与控制系统的深度协同,如:视觉引导抓取、语音指令操控、LLM驱动的任务规划等;

4)开发自定义的人机交互方式和处理逻辑,体现终端的智能化;

5)应用方向不限,如工业场景、教育应用、机器人、智能家居、AI智能硬件等,也可以直接开发AI应用,如RAG系统。

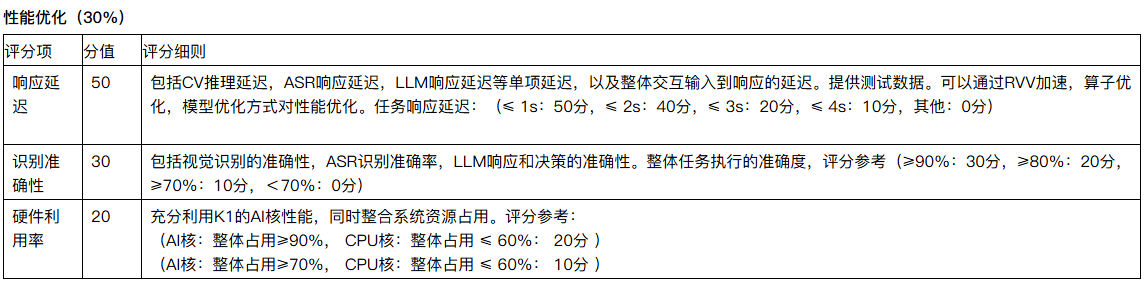

2.评分标准

3.参考资料

• 进迭时空开发者社区:https://developer.spacemit.com/

• BianbuCloud云平台使用指南:https://active.spacemit.com

• K1 MUSEPI Pro开发板使用文档:https://developer.spacemit.com/documentation?token=EIk1wVY9NinD95kMsw0cFM89npd

• Bianbu 操作系统介绍:https://bianbu.spacemit.com/

• Bianbu Ollama介绍:https://bianbu.spacemit.com/ai/ollama

• Bianbu llama.cpp介绍:https://bianbu.spacemit.com/ai/llama-cpp

赛题2 基于K1 AI CPU的大模型部署落地

边缘场景下,海量的设备(如儿童玩具、智能音响、扫地机器人等),都需要智能化升级交互方式。目前的设备,要么模型能力不够,智能化水平不足;要么需要云端协同,容易泄露隐私,因此需要将模型本地化部署。本赛题要求将qwen2.5-14B模型,成功部署到K1芯片上。

1.项目要求

1)基础功能

AI模型本地化:模型本地化部署到8GB内存容量版本的K1上

部署工具:使用进迭时空开源的部署工具,llamacpp及ONNXRuntime进行部署

2)创新功能

模型层面:可以对模型进行量化、稀疏等压缩,降低硬件使用成本

部署工具层面:可以通过调优部署工具的调度方案,优化底层算子等方式来加速模型推理速度

2.评分标准

3.参考资料

• Bianbu onnxruntime 介绍:https://bianbu.spacemit.com/ai/onnxruntime

• Bianbu Ollama 介绍:https://bianbu.spacemit.com/ai/ollama

• Bianbu llama.cpp 介绍:https://bianbu.spacemit.com/ai/llama-cpp

赛题3 基于本地大模型的AI智能助手开发

本赛题要求基于进迭时空Bianbu OS系统,利用K1芯片AI算力、RVV向量加速能力,开发本地运行的AI系统助手。该助手需通过自然语言交互实现应用控制、文件管理、系统操作等任务,打造真正懂操作系统的AI智能体,让用户通过文本交互控制系统。

1.项目要求

1)基于进迭时空RISC-V AI CPU K1平台,在进迭时空Bianbu系统上,使用本地推理框架完成功能开发;

2)可以通过AI助手可以完成如下功能控制:

•应用控制,如启动/关闭应用(如“打开视频播放器”);

•实现系统操作,比如关机,重启,休眠等;

•系统设置,比如音量,亮度等;

•系统信息查询,如CPU占有率,内存占有率等;

•不限于以上的其他功能;

• 实现多轮对话上下文记忆(记忆轮数≥3);

• 开发完整的图形交互应用,可以基于WEB、QT等框架。

2.评分标准

3.参考资料

• 进迭时空开发者社区:https://developer.spacemit.com/

• BianbuCloud云平台使用指南:https://active.spacemit.com

• K1 MUSEPI Pro开发板使用文档:https://developer.spacemit.com/documentation?token=EIk1wVY9NinD95kMsw0cFM89npd

• Bianbu 操作系统介绍:https://bianbu.spacemit.com/

• Bianbu Ollama介绍:https://bianbu.spacemit.com/ai/ollama

• Bianbu llama.cpp介绍:https://bianbu.spacemit.com/ai/llama-cpp

赛题4 融合AI的OpenHarmony应用软件开发

参赛作品需基于进迭时空K1+OpenHarmony 5.0 SDK版本开发,典型开发方向包括但不限于:多媒体应用,文件管理应用,社交应用等,需集成至少一种AI能力(如ASR、LLM),并将该能力有效的融合在应用中。

1.项目要求

1)基于进迭时空 + K1 OpenHarmony 5.0版本开发

2)应用开发方向包括但不限于:多媒体应用,文件管理应用,社交应用

3)AI能力应用包括但不限于:

•多媒体应用类:音视频AI处理(如智能剪辑、实时翻译字幕等)

•文件管理应用类:智能分类/检索

•社交应用类:AI辅助交互功能(如智能回复生成)

4)AI能力可选择调用云端或者端侧,对于低算力场景建议走端侧

2.评分标准

3.参考资料

• K1 OpenHarmony简介:https://developer.spacemit.com/documentation?token=JuxFwQceHihZcakfyrGcIFs5n8d

• BianbuCloud云平台使用指南:https://active.spacemit.com

• K1常用开发板简介:https://developer.spacemit.com/documentation?token=FpxwwKJc8iGvTdkuLihcxQZMnle

• OpenHarmony官网:https://www.openharmony.cn/mainPlay

• OpenHarmony应用开发指南:https://www.openharmony.cn/docs/zh-cn/application-dev/